勃興するAI版“車検制度” 差別しないAIをどう作る? 海外では「品質保証」が産業に

人間中心のAI社会原則(内閣府発表資料より抜粋)

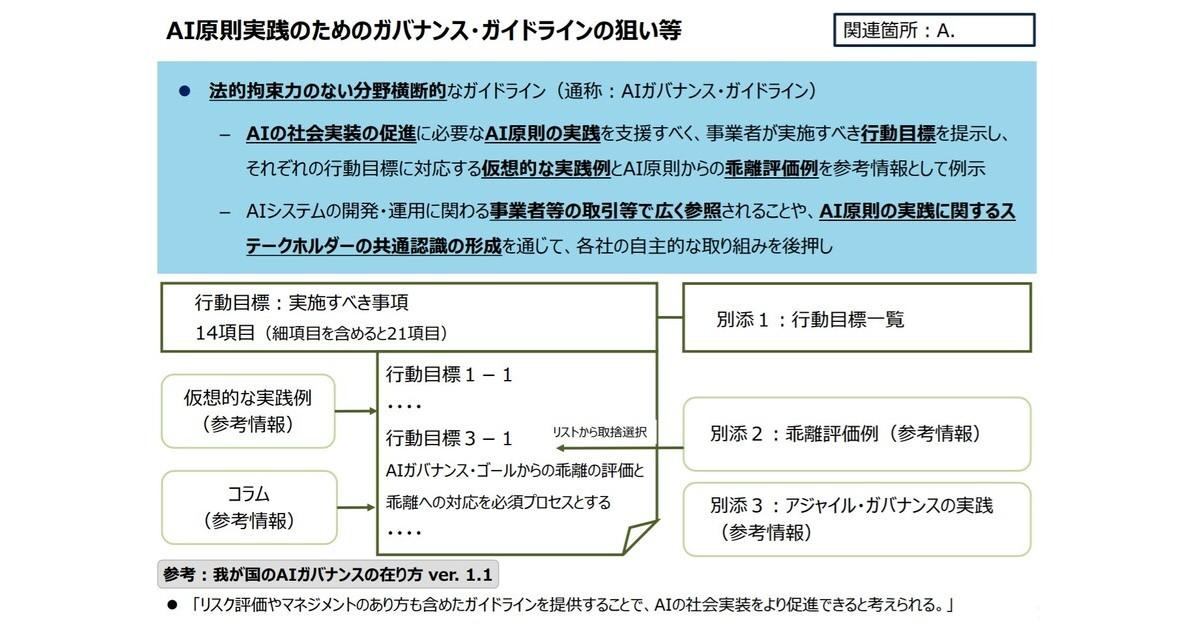

IDC Japanが2021年6月に発表した予測によれば、国内AI市場はコロナ禍後も急速に成長を続け、2025年までにおよそ5000億円に達すると見込まれている。IDCはこの理由を「COVID-19によって企業変革の重要性を再認識した結果、AIへの投資が加速したため」と分析している。【画像】AIガバナンス・ガイドラインの概要(経産省発表資料より抜粋) AIの導入は、私たちにさまざまな恩恵をもたらしている。しかし一方で、各所で報じられている通り、AIの品質が保たれないことによる問題も生まれている。AIの判断ミスによるビジネス上の損失や、特定の性別や人種、社会層に対する差別の発生といった問題だ。その多くは意図的にもたらされたものではなく、ささいなミスや怠慢、リスク管理の不備といった要因が積み重なった結果として生じている。 新たなテクノロジーが普及する際には、こうしたミスを防いで品質を一定に保つ努力が求められる。例えば自動車の場合は車検制度(自動車検査登録制度)があるが、日本の車検の歴史を見てみると、1920年代の国内における自動車普及を受けて、1930年にタクシーやバスを対象とした定期検査制度を義務化している。 自動車という新たなテクノロジーの恩恵を受ける一方で、そのマイナス面を回避するために、品質を保つためのルールが整備されたわけだ。AIの場合も同様に、その急速な普及を受けて、品質を検査・保証する制度が整備されると予測できるだろう。

どうやってAIの品質を保証するか

既にさまざまな組織や機関が、AIの品質を保証するルールやガイドラインの検討を進めており、原理・原則のレベルにとどまらない詳細な内容を提示しているものも少なくない。そうしたルールの提示を、政府が主導で行う例も登場している。 日本の場合を見てみると、2018年5月に内閣府が「人間中心のAI社会原則検討会議」を設置し、2019年3月に「人間中心のAI社会原則」を発表している。これは「社会がAIを受け入れ適正に利用するため、社会が留意すべき基本原則」と位置付けており、その内容は文字通り原理・原則レベルにとどまるが、多くの企業において、AIに関する具体的なルールを整備する際の議論の出発点となっている。 こうした原則を実現するための、具体的な行動についてのアドバイスも行われるようになっている。経済産業省は2021年7月9日に「AI原則実践のためのガバナンス・ガイドライン」を発表している(2022年1月28日にバージョン1.1を公開した)。 これはタイトルの通り、人間中心のAI社会原則を具体的に実践するためのガイドラインとして作成したもので、法的な拘束力はなく、AIシステムの開発や運用を手掛ける事業者などが自主的に参考にすることを想定している。 ガイドラインはAI事業者が実施すべき行動目標(細項目を含め21項目)と、それぞれの行動目標に対応する実践例、ならびにAI原則からの乖離(かいり)評価例を例示するという構成になっており、具体的な行動を解説している。 法的拘束力はないということもあって、どのような行動を実際に取るかの採否は事業者に委ねられているものの、これからAIの品質を担保するためのガバナンス体制を構築するという企業にとって、検討のよりどころになる内容となっている。 一方で、限定的ではあるが、さまざまな形で強制力のあるAI品質保証を求める事例も登場している。 興味深いのは、米ニューヨーク市で2021年末に可決された条例案「Int 1894-2020」だ。この法案は、AIを使った雇用判断ツール(対象となった応募者を採用すべきか、あるいは特定の社員を昇進させるべきかといった判断を自動で行うアプリケーション)について、それを使用する雇用主などに対して「バイアス(偏見)監査」を求める内容となっている。 同法案の定義によれば、バイアス監査とは、独立した監査人による公正な評価で、AIが人種や性別といった要因によって、差別的な判断を行っていないかどうかを判断するものとしている。AI雇用判断ツールを使う事業者は、こうしたバイアス監査を年1回行い、その結果を一般に公表しなければならない。 法案では、ツールの対象となる候補者や社員へ使用を事前告知することや、彼らが求めた場合にはAIツール以外の評価方法(つまり従来型の人間による判断)を用意するなどを義務化していた。 この法案は議会を通過したものの、残念ながら2021年12月13日、当時のニューヨーク市長だったビル・デブラシオの署名を得られず発効には至らなかった。発効されていたとしても「独立した監査人による公正なバイアス評価」を実現できるのかどうか、実現できたとして大きなコストがかかるものであれば、AIツールの導入を妨げるものになったのではないかという批判もある。 とはいえこのようなルールが一度は立法府で可決されたという事実は、今後同様の規制が広がってゆく可能性を示したものといえるだろう。